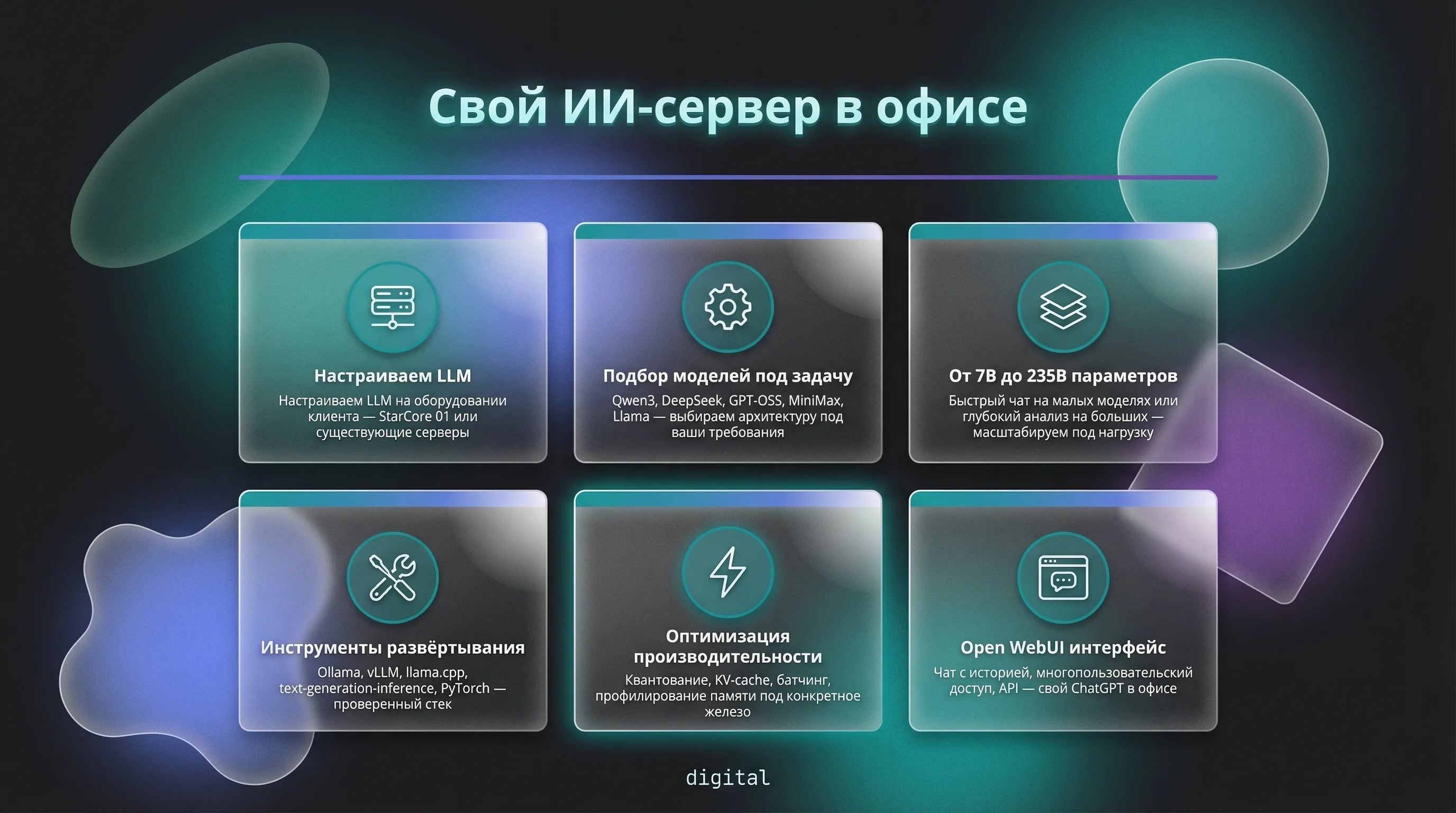

Команда NovaDeploy разворачивает автономные модули искусственного интеллекта непосредственно в инфраструктуре вашей компании. Локальные языковые модели работают без передачи данных внешним провайдерам, обеспечивая полный контроль над конфиденциальной информацией и снижая операционные расходы на API-запросы. Мы калибруем системы под специфику бизнес-процессов, настраиваем inference-серверы и интегрируем решения с корпоративными базами знаний.

Автономность вычислительных модулей

По данным исследований Gartner за 2024 год, компании, развернувшие локальные LLM, сокращают расходы на облачные API на 70-85% при обработке более 100 000 запросов ежемесячно. Собственная инфраструктура обеспечивает независимость от внешних сервисов и гарантирует соответствие требованиям регуляторов по защите персональных данных.

Калибровка бортовых систем искусственного интеллекта

Развертывание локальных языковых моделей начинается с анализа вычислительных ресурсов и выбора архитектуры. NovaDeploy работает с открытыми моделями семейств Llama 3, Mistral, Qwen и GigaChat, адаптируя их под задачи обработки текста, генерации контента или технической поддержки. Мы оцениваем требования к памяти GPU, пропускной способности и латентности, чтобы система работала стабильно под нагрузкой.

Компании финансового сектора и государственные организации выбирают локальные LLM из-за требований регуляторов. Данные не покидают периметр инфраструктуры, что критично для обработки персональной информации и коммерческой тайны. Аналитика AI Infrastructure Report 2024

Процесс настройки включает установку inference-серверов vLLM или TGI, конфигурацию квантизации моделей для экономии памяти и тестирование производительности. Команда NovaDeploy подбирает оптимальный баланс между размером модели и качеством ответов, используя техники GPTQ или AWQ для сжатия весов без критической потери точности.

Протоколы развертывания и интеграции

Локальные модели разворачиваются на серверах с GPU NVIDIA A100, H100 или AMD MI300, в зависимости от бюджета и требований к throughput. Мы настраиваем Docker-контейнеры с изолированными окружениями, конфигурируем балансировщики нагрузки и мониторинг метрик inference. Интеграция с корпоративными системами происходит через REST API или gRPC, что позволяет подключать модели к CRM, ERP или внутренним порталам.

| Параметр | Облачные LLM | Локальные LLM |

|---|---|---|

| Контроль данных Параметр | Данные передаются провайдеру Облачные LLM | Полный контроль, данные остаются внутри Локальные LLM |

| Стоимость при высокой нагрузке Параметр | Растет пропорционально запросам Облачные LLM | Фиксированная стоимость инфраструктуры Локальные LLM |

| Латентность Параметр | Зависит от сети и загрузки API Облачные LLM | Минимальная, обработка на месте Локальные LLM |

| Настройка под задачи Параметр | Ограничена возможностями API Облачные LLM | Полная кастомизация и fine-tuning Локальные LLM |

| Зависимость от провайдера Параметр | Высокая, риск изменения условий Облачные LLM | Отсутствует, полная автономность Локальные LLM |

Команда NovaDeploy настраивает мониторинг ключевых метрик: tokens per second, memory utilization, queue depth и error rate. Это позволяет оперативно выявлять узкие места и масштабировать систему при росте нагрузки. Мы используем Prometheus и Grafana для визуализации данных и настройки алертов при превышении пороговых значений.

|

Активируйте автономный модуль ИИ в вашей инфраструктуре

|

Запустить

|

Fine-tuning и адаптация под бизнес-процессы

Точная калибровка под корпоративные данные

Fine-tuning локальных моделей на внутренних датасетах повышает точность ответов на 25-40% по сравнению с базовыми версиями. Мы используем техники LoRA и QLoRA для эффективного обучения без полной перезаписи весов, что экономит вычислительные ресурсы и время.

Процесс адаптации начинается со сбора и разметки корпоративных данных: документации, переписки, технических спецификаций или базы знаний. NovaDeploy подготавливает датасеты в формате instruction-following, где каждый пример содержит запрос пользователя и ожидаемый ответ. Это позволяет модели научиться отвечать в стиле компании и оперировать специфической терминологией.

Баланс параметров развертывания

Выбор между скоростью inference, качеством ответов и стоимостью железа требует компромиссов. Модели 70B+ дают лучшие результаты, но требуют дорогих GPU. Квантизованные версии 7-13B работают быстрее и дешевле, но могут уступать в сложных задачах. NovaDeploy помогает найти оптимальную точку под ваш бюджет и требования.

Интеграция с корпоративными системами

Стыковка с существующей инфраструктурой

Локальные LLM подключаются к CRM, ERP, системам документооборота и внутренним порталам через REST API или SDK. Мы разрабатываем адаптеры для 1С, Битрикс24, SAP и других платформ, обеспечивая бесшовную интеграцию без переделки существующих процессов.

Команда NovaDeploy настраивает middleware-слой для обработки запросов от пользовательских интерфейсов к inference-серверу. Это включает валидацию входных данных, управление контекстом диалога, кэширование частых запросов и rate limiting для защиты от перегрузок. Мы используем Redis для хранения сессий и векторные базы данных для RAG-систем, расширяющих возможности модели доступом к актуальной документации.

- Разработка REST API и gRPC-интерфейсов для подключения к корпоративным системам

- Настройка векторных баз данных Qdrant или Milvus для семантического поиска

- Интеграция с системами аутентификации LDAP, OAuth2 или SAML

- Конфигурация балансировщиков нагрузки для распределения запросов между GPU

- Настройка мониторинга и алертинга через Prometheus, Grafana или Zabbix

Для задач обработки естественного языка мы настраиваем пайплайны с предобработкой текста, токенизацией и постобработкой результатов. Это включает фильтрацию нежелательного контента, форматирование ответов под требования интерфейса и логирование взаимодействий для последующего анализа. Интеграция с корпоративными платформами позволяет автоматизировать рутинные задачи и повысить эффективность сотрудников.

Оптимизация производительности и масштабирование

- Квантизация моделей

- Применение техник GPTQ, AWQ или GGUF для сжатия весов с FP16 до INT4/INT8, что снижает требования к памяти в 2-4 раза без критической потери качества. Это позволяет запускать большие модели на менее мощном железе.

- Tensor parallelism

- Распределение слоев модели между несколькими GPU для обработки больших архитектур 70B+. Мы настраиваем DeepSpeed или Megatron-LM для эффективного использования кластеров GPU с минимальными накладными расходами на коммуникацию.

- Continuous batching

- Динамическое формирование батчей запросов для максимизации утилизации GPU. Вместо ожидания заполнения фиксированного батча система обрабатывает запросы по мере поступления, снижая латентность и повышая throughput.

- KV-cache оптимизация

- Эффективное управление кэшем ключей и значений attention-механизма для экономии памяти при длинных контекстах. Мы используем PagedAttention и другие техники для обработки диалогов с историей до 32K токенов.

Типичная конфигурация inference-сервера vLLM для модели Llama 3.1 70B на 4x A100 80GB обеспечивает throughput 150-200 tokens/sec при batch size 32 и latency первого токена около 200ms. Квантизация до INT4 позволяет запустить ту же модель на 2x A100 с throughput 100-120 tokens/sec. Бенчмарки vLLM Performance Report

Масштабирование системы происходит горизонтально через добавление inference-серверов за балансировщиком нагрузки или вертикально через апгрейд GPU. NovaDeploy настраивает автоматическое масштабирование на базе Kubernetes с мониторингом метрик нагрузки. При росте числа запросов система автоматически запускает дополнительные поды с моделью, а при снижении нагрузки освобождает ресурсы.

Сопровождение и обновление моделей

Орбитальное сопровождение систем ИИ

После запуска локальных LLM команда NovaDeploy обеспечивает техническую поддержку, мониторинг производительности и регулярные обновления моделей. Мы отслеживаем релизы новых версий открытых архитектур и проводим тестирование перед миграцией на production.

Сопровождение включает анализ логов взаимодействий для выявления проблемных запросов, дообучение модели на новых данных и оптимизацию промптов. Мы собираем обратную связь от пользователей и корректируем поведение системы через fine-tuning или настройку system prompts. Регулярные аудиты безопасности проверяют систему на уязвимости и соответствие актуальным стандартам защиты данных.

Криптографический щит корпоративных данных

Локальное развертывание LLM обеспечивает полную изоляцию обучающих данных и запросов от внешних серверов. По данным исследований 2024 года, 78% компаний в финансовом секторе и 85% в здравоохранении выбирают on-premise решения именно из соображений конфиденциальности. Команда NovaDeploy реализует многоуровневые протоколы защиты, исключающие передачу чувствительной информации за периметр инфраструктуры.